Imaginez un musicien professionnel capable d’explorer de nouvelles compositions sans jouer une seule note, ou un développeur de jeux indépendant peuplant des mondes virtuels avec des effets sonores réalistes et du bruit ambiant avec un budget limité. C’est la promesse d’AudioCraft, une innovation majeure de Meta, qui génère des audios et de la musique de haute qualité à partir d’entrées utilisateur en texte. Écoutez plutôt ce que l’on peut générer avec du texte…

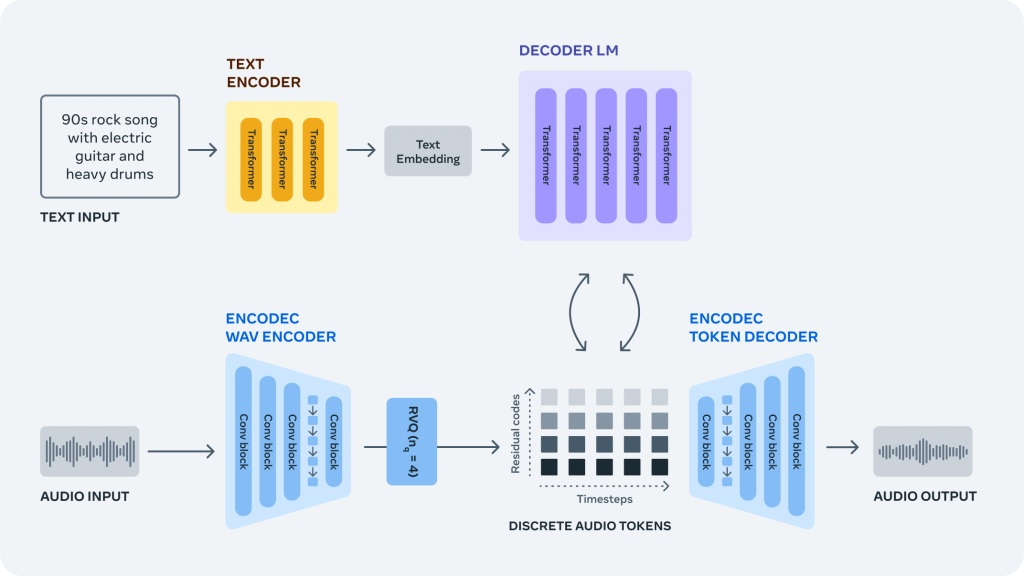

AudioCraft se compose de trois modèles : MusicGen, AudioGen et EnCodec. MusicGen génère de la musique à partir d’entrées utilisateur en texte, tandis qu’AudioGen génère de l’audio à partir de ces mêmes entrées. EnCodec, quant à lui, est un décodeur amélioré qui permet une génération de musique de meilleure qualité avec moins d’artefacts.

Ces modèles sont disponibles à des fins de recherche et pour approfondir la compréhension des gens de la technologie. Ils offrent aux chercheurs et aux praticiens la possibilité de former leurs propres modèles avec leurs propres jeux de données pour la première fois, ce qui pourrait aider à faire avancer l’état de l’art.

La famille de modèles AudioCraft est capable de produire un audio de haute qualité avec une cohérence à long terme. On peut facilement interagir avec grâce à une interface naturelle. Avec AudioCraft, Meta simplifie la conception globale des modèles génératifs pour l’audio par rapport aux travaux antérieurs dans le domaine.

AudioCraft fonctionne pour la génération et la compression de musique et de son. Il est facile à construire et à réutiliser, ce qui signifie que les personnes qui veulent construire de meilleurs générateurs de son, des algorithmes de compression, ou des générateurs de musique peuvent le faire dans la même base de code et construire sur ce que d’autres ont fait.

L’équipe de Meta travaille à améliorer les modèles actuels en augmentant leur vitesse et leur efficacité d’un point de vue de modélisation et en améliorant la façon dont nous contrôlons ces modèles, ce qui ouvrira de nouveaux cas d’utilisation et de nouvelles possibilités.

En partageant le code pour AudioCraft, Meta espère que d’autres chercheurs pourront plus facilement tester de nouvelles approches pour limiter ou éliminer les biais potentiels dans et l’utilisation abusive des modèles génératifs.

Avec AudioCraft, Meta voit un avenir où l’IA générative pourrait aider les gens à améliorer considérablement le temps d’itération en leur permettant d’obtenir des retours plus rapidement pendant les premières étapes de prototypage. Que vous soyez un développeur de grande taille construisant des mondes pour le métaverse, un musicien travaillant sur sa prochaine composition, ou un propriétaire de petite ou moyenne entreprise cherchant à améliorer leurs actifs créatifs, AudioCraft est une étape importante en avant dans la recherche sur l’IA générative.

Musicgen utilise 400 000 titres du catalogue de musique qui appartient à Meta. La question de la Propriété Intellectuelle se pose sur la génération de musique issues de musiques dont seul Meta possède les IP (La Propriété Intellectuelle). Affaire à suivre. (Merci à Christophe Romei pour le post sur COOL :-)

Pour en savoir plus (en anglais) : cliquez ici

Écoutez plutôt

AudioGen

Le prompt (c’est à dire le texte écrit pour générer ce son apar l’IA) :

Sifflement avec vent soufflant

Le résultat :

Le prompt :

Des sirènes et un moteur vrombissant s’approchent et passent

Le résultat :

MusicGen

Le prompt :

Titre de danse pop avec des mélodies accrocheuses, des percussions tropicales et des rythmes entraînants, parfait pour la plage.

Le résultat :

Le prompt :

Earthy tones, environmentally conscious, ukulele-infused, harmonic, breezy, easygoing, organic instrumentation, gentle grooves

Le résultat :